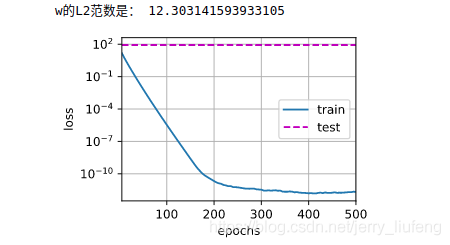

正则化通过为模型损失函数添加惩罚项使学出的模型参数值较小,是应对过拟合的常用手段。 L2 范数正则化(regularization) L2 范数正则化在模型原损失函数基础上添加 L2 范数惩罚项,从而得到训练所需要最小化的函数...

”动手学 动手学深度学习 学习 机器学习 权重 欠拟合 正则化 深度学习 范数 过拟合“ 的搜索结果

文章目录一、过拟合、欠拟合概念二、多项式函数拟合实验2.1 初始化模型参数2.2 定义、训练和测试模型三阶多项式函数拟合(正常)线性函数拟合(欠拟合)训练样本不足(过拟合)2.3 权重衰减L2 范数正则化...

最近参加了伯禹平台和Datawhale等举办的《动手学深度学习PyTorch版》课程,对过拟合,欠拟合,梯度消失,梯度爆炸做下笔记。 过拟合和欠拟合 模型无法得到较低的训练误差,我们将这一现象称作欠拟合(underfitting)...

解决过拟合的方法:权重衰减(L2 范数正则化)和丢弃法 2.梯度消失和梯度爆炸 a.梯度消失和梯度爆炸 假设一个层数为LL的多层感知机的第ll层H(l)H(l)的权重参数为W(l)W(l),输出层H(L)H(L)的权重参数为W(L)W(L)。为了...

本文深入探讨了过拟合、欠拟合及其平衡,理解了正则化的基本概念并展示了其在防止过拟合中的作用。我们通过实验验证了正则化(如岭回归、Lasso回归)在缓解过拟合和提高模型泛化能力上的有效性。总结来说,正则化是...

(那么自然而然会产生的问题就是:为什么不对偏置做正则化,这个可以去实验一下,应该会发现偏置没有权重敏感) 丢弃法。我的理解是,按照设定的概率丢掉(置为0)某个参数单元,从而减少参数依赖性。丢掉

过拟合、欠拟合及其解决方案 过拟合和欠拟合 一类是模型无法得到较低的训练误差,我们将这一现象称作欠拟合(underfitting); 另一类是模型的训练误差远小于它在测试数据集上的误差,我们称该现象为过拟合...

一 过拟合、欠拟合及其解决方案 欠拟合(underfitting): 一类是模型无法得到较低的训练误差,我们将这一现象...权重衰减等价于 L2L_2L2 范数正则化(regularization)。正则化通过为模型损失函数添加惩罚项使学出

一、深度学习中的一些常见问题及解决方案 (1)欠拟合 欠拟合即模型无法得到较低的训练误差,导致欠拟合的主要原因是模型复杂度不够,...*权重衰减:等价于 L2范数正则化(regularization)。正则化通过为模型损失函

过拟合和欠拟合 测试数据集不可以用来调整模型参数,如果使用测试数据集调整模型参数,可能在测试数据集...L2范数正则化也就是权重衰减是用来应对过拟合的。 梯度消失和梯度爆炸 在激活函数的选择的地方讲过,在深层网

正则化在深度学习的出现前就已经被使用了数十年。线性模型,如线性回归和逻辑回归可以使用简单、直接、有效的正则化策略。许多正则化方法通过对目标函数J添加一个参数范数惩罚Ωθ限制模型的学习能力。Jθ;XyJθ;Xy...

《动手学深度学习》pytorch版笔记2 Task3 过拟合、欠拟合及其解决方案 这部分内容比较简单,写下问题吧,再挖几个坑 1.模型复杂度如何改变,三阶到一阶等 2.L2范数正则化为什么是权重衰减的一种方式? 梯度消失,...

L2 范数正则化 高维线性回归实验 2. 梯度消失、梯度爆炸 梯度消失 梯度爆炸 模型训练和预测 3. 卷积神经网络基础 二维卷积层 二维互相关运算 特征图与感受野 填充和步幅 多输入通道和多输出通道 卷积层与全连接层的...

想要彻底弄明白L2范数,必须要有一定的矩阵论知识,L2范数涉及了很多的矩阵变换。在我们进行数学公式的推到之前,我们先对L2范数有一个感性的认识。... 说到正则化,我们要看一下,正则化在深度学习中含义是指什么...

与其他机器学习技术结合使用,如线性回归和逻辑回归,正则化技术可以有效地减少过拟合问题,并增加模型的普适性和稳健性。L2正则化是以参数权重二次方之和作为惩罚项,可以使得参数权重变得更加平滑,从而缓解过度...

前言本文讨论了机器学习中正则化这个话题,对于L1正则项为什么稀疏也是面试中经常涉及的。概要正则化是机器学习中防止过拟合的一种重要技术。从数学上讲,它增加了一个正则化项,以防止系数如此完美地...

正则化是为了降低模型的复杂度,模型过于复杂,则过拟合; 与傅里叶变换类似,高频的部分表示细节,尽量减少高频部分的影响; 傅里叶级数也是,高阶表示细节; 当阶数较高时,在不降低拟合结果的前提下,降低高阶...

推荐文章

- Unity3D 导入资源_unity怎么导入压缩包-程序员宅基地

- jqgrid 服务器端验证,javascript – jqgrid服务器端错误消息/验证处理-程序员宅基地

- 白山头讲PV: 用calibre进行layout之间的比对-程序员宅基地

- java exit方法_Java:如何测试调用System.exit()的方法?-程序员宅基地

- 如何在金山云上部署高可用Oracle数据库服务_rman target sys/holyp#ssw0rd2024@gdcamspri auxilia-程序员宅基地

- Spring整合Activemq-程序员宅基地

- 语义分割入门的总结-程序员宅基地

- SpringBoot实践(三十五):JVM信息分析_怎样查看springboot项目的jvm状态-程序员宅基地

- 基于springboot+vue的戒毒所人员管理系统 毕业设计-附源码251514_戒毒所管理系统-程序员宅基地

- 【LeetCode】面试题57 - II. 和为s的连续正数序列_leet code 和为s的正数序列 java-程序员宅基地